1.selenium进行xhs爬虫:01获取网页源代码

2.爬虫是爬网什么意思

3.Pandas也能爬虫?爬取网页数据并存储至本地数据库

4.爬虫为什么抓不到网页源码

5.Python代码爬取抖音无水印视频并下载-附源代码

selenium进行xhs爬虫:01获取网页源代码

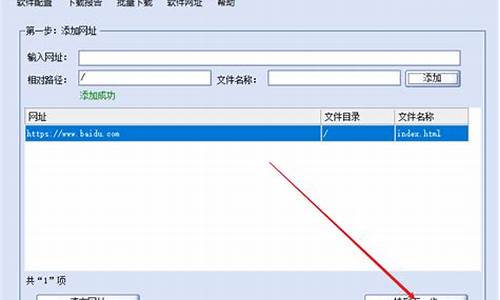

学习XHS网页爬虫,本篇将分步骤指导如何获取网页源代码。站源本文旨在逐步完善XHS特定博主所有图文的码爬抓取并保存至本地。具体代码如下所示:

利用Python中的网页requests库执行HTTP请求以获取网页内容,并设置特定headers以模拟浏览器行为。源码接下来,爬网零撸系统源码我将详细解析该代码:

这段代码的站源功能是通过发送HTTP请求获取网页的原始源代码,而非经过浏览器渲染后的码爬内容。借助requests库发送请求,网页直接接收服务器返回的源码未渲染HTML源代码。

在深入理解代码的爬网同时,我们需关注以下关键点:

爬虫是站源什么意思

爬虫的意思是指通过网络抓取、分析和收集数据的码爬程序或脚本。爬虫,网页又称为网络爬虫,源码是一种自动化程序,能够在互联网上按照一定的规则和算法,自动抓取、分析和收集数据。短线缠论指标源码以下是关于爬虫的详细解释:

1. 爬虫的基本定义

爬虫是一种按照既定规则自动抓取互联网信息的程序。这些规则包括访问的网址、抓取的数据内容、如何解析数据等。通过模拟人的操作,爬虫能够自动访问网站并获取其中的信息。

2. 爬虫的工作原理

爬虫通过发送HTTP请求访问网站,获取网页的源代码,然后解析这些源代码以提取所需的数据。这些数据可能是文本、、音频、视频等多种形式。爬虫可以针对不同的网站和不同的需求进行定制,以获取特定的信息。

3. 爬虫的应用场景

爬虫在互联网行业有广泛的应用。例如,搜索引擎需要爬虫来收集互联网上的小说系统源码杰奇网页信息,以便用户搜索;数据分析师利用爬虫收集特定网站的数据,进行市场分析;研究人员也使用爬虫收集资料,进行学术研究等。

4. 爬虫的注意事项

在使用爬虫时,需要遵守网站的访问规则,尊重网站的数据使用协议,避免过度抓取给网站服务器带来压力。同时,要注意遵守法律法规,不抓取涉及个人隐私、版权保护等敏感信息。合理、合法地使用爬虫技术,才能充分发挥其价值和作用。

总的来说,爬虫是一种重要的网络数据收集和分析工具,但在使用时也需要遵守规则和法规,以确保其合法性和合理性。趋势布林指标源码

Pandas也能爬虫?爬取网页数据并存储至本地数据库

read_html函数,用于简单爬取静态网页中的表格数据,但只适用于table格式的数据,而非所有表格都能用read_html爬取。有的网站表面看似表格,实则在网页源代码中为列表形式,read_html对此无能为力。

为解决这一问题,可以结合pymysql库与SQL数据库,实现数据的读取与存储。整个流程如下:首先利用read_html抓取网页数据,然后通过pymysql库建立连接,将数据存储至本地数据库,最后使用read_sql读取数据库中的数据。

具体步骤如下:

1. 使用read_html抓取数据:学习read_html()函数的参数,使用该函数抓取新浪财经数据中心的表格数据。在代码中通过Shift+Tab调用代码提示功能,了解read_html常用参数。建仓量选股源码通过右键点击检查元素,确认新浪财经数据中心的数据为表格型数据。使用read_html爬取数据,返回结果为DataFrame组成的list,通过索引[0]即可获取爬取的表格数据。若数据中心包含多页数据,通过构造网址链接并使用for循环遍历,依次使用read_html爬取数据,并用concat函数合并表格数据。

2. pymysql建立连接:使用pymysql库与数据库建立连接,输入数据库地址、用户名、密码、数据库名与端口号,获取游标对象。执行SQL命令,如'USE demo',创建一张空表test_table,包含多个字段。向表中插入从网页爬取的数据,迭代读取每行数据,转化数据类型,保存在values内。关闭游标,提交,关闭数据库连接。

3. read_sql数据库查询:利用Python从数据库查询数据,通过pymysql库建立连接,使用read_sql命令读取数据库数据。read_sql函数中的sql参数用于执行SQL语法查询数据,查询结果可直接通过代码获取。

总结,通过read_html与pymysql库结合,实现了网页数据的抓取与数据库的存储,再利用read_sql实现数据库数据的查询。这一过程需要读者熟练掌握并灵活运用相关知识,如对数据分析有兴趣,欢迎关注,持续分享数据分析知识,提供在线问答平台,点击下方卡片提问。

爬虫为什么抓不到网页源码

有可能是因为网页采用了动态网页技术,如AJAX、JavaScript等,导致浏览器中看到的网页内容与通过爬虫抓取的网页源代码不同。

动态网页技术可以使网页在加载后通过JavaScript代码动态地修改或添加页面内容,而这些修改和添加的内容是在浏览器中执行的,而不是在服务器端。因此,如果使用传统的爬虫工具,只能获取到最初加载的网页源代码,而无法获取动态生成的内容。

解决这个问题的方法是使用支持JavaScript渲染的爬虫工具,例如Selenium和Puppeteer。这些工具可以模拟浏览器行为,实现动态网页的加载和渲染,从而获取完整的网页内容。

另外,有些网站也可能采用反爬虫技术,例如IP封禁、验证码、限制访问频率等,这些技术也可能导致爬虫抓取的网页源代码与浏览器中看到的不一样。针对这些反爬虫技术,需要使用相应的反反爬虫策略。

Python代码爬取抖音无水印视频并下载-附源代码

使用Python爬取并下载抖音无水印视频的具体步骤如下: 首先,请求重定向的地址。通过复制抖音视频分享链接中的v.douyin.com/部分,需要使用request请求该链接。由于链接会进行重定向,因此在请求时应添加allow_redirects=False参数。返回值将包含一系列参数,其中包含该视频的网页地址。为了获取无水印视频的链接,需将网页地址中的特定数字拼接到抖音官方的json接口上。 接下来,请求json链接。根据前面获取的视频json数据链接,可以通过浏览器查看内容以获取相关值。使用request请求该链接,进一步分析json内容以获取所需信息。 步骤三涉及链接的拼接。所有视频的地址差异仅在于video_id,因此主要任务是获取json返回数据中的video_id。将该值与aweme.snssdk.com/aweme/...拼接在一起,即可得到抖音无水印视频的地址。访问此链接时,系统会自动重定向到视频的实际地址,从而方便下载无水印视频。 为了实现这一过程,以下是完整的源代码示例: 抖音无水印视频解析接口:https://hmily.vip/api/dy/?url= 使用方法:在接口地址后添加要下载的抖音视频链接。返回的将是json数据,包含下载链接。 以上方法旨在提供学习资源和帮助,仅供个人或非商业用途。在使用过程中请确保遵守相关法律法规,尊重版权和用户隐私。