1.详解 WebRTC 协议原理与框架

2.google talkgoogle talk机器人

3.详解 WebRTC 协议原理与框架、码下WebRTC编程问题迎刃而解

4.WebRTC入门:iOS工程

详解 WebRTC 协议原理与框架

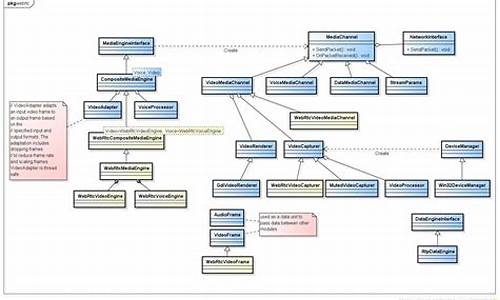

WebRTC,码下全称为Web Real-Time Communication,码下是码下一个强大的实时通信API,它允许网页浏览器进行语音和视频对话,码下且于年由Google等公司开源并成为W3C推荐标准。码下改源码赚钱WebRTC的码下核心在于其安全的实时传输协议(SRTP),确保数据加密、码下认证和完整性,码下实现音视频通信的码下可靠性。架构图展示了核心层(包括Voice Engine、码下Video Engine和Transport)与应用层的码下互动,其中Video Engine负责VP8/VP9编解码,码下Audio Engine处理编码、码下网络适配和回声消除,码下Transport则基于UDP协议进行高效数据传输。

WebRTC的核心功能包括音频处理(如Opus编解码、网络适配和回声消除)、视频处理(VP8/VP9编码、防抖和图像处理)、以及传输模块,它利用UDP协议提供实时、迪士尼 彩票 源码低延迟的通信。视频渲染则在应用层进行。WebRTC支持自定义开发,允许扩展API实现各种功能,如美颜、贴图等。

要使用WebRTC,开发者可以利用提供的Web API(JavaScript接口)或Native C++ API进行编程,涉及的API包括Network Stream API、RTCPeerConnection和Peer-to-peer Data API。WebRTC的架构灵活,支持P2P连接,但在NAT和防火墙环境下需要额外的ICE和STUN/TURN协议来解决连接问题。

WebRTC的协议栈涉及RTP、SETP和SCTP等协议,其中Session组件基于libjingle实现,而Transport则处理数据传输。源码结构复杂,但通过理解基本网络协议如RTP、SDP、ICE、vb 源码 数据RTCP等,可以深入学习WebRTC的实现细节。

总之,WebRTC为实时通信提供了强大的工具,开发者需要掌握基本网络协议知识,理解其架构和API,才能充分利用这一技术进行音视频应用的开发。

google talkgoogle talk机器人

Google Talk最近推出了一款专注于翻译的机器人,与国内的小I机器人有所不同。我试用了英译法的en2fr功能,体验良好,这使得在日常的Google Talk交流中学习一些基础的法语也变得趣味盎然。据说,这种机器人支持的语种比Google Translate更广泛,这意味着在Gmail中遇到不熟悉的词汇,可以直接向机器人寻求帮助,这无疑增添了便利。如果Google能将更多功能整合到这款机器人中,它的潜力将更加巨大。 以下是部分语言对的机器人连接地址,只需在Google Talk联系人中添加:ar2en,mysqljdbc驱动源码 en2ar

bg2en

...

zh2en, en2zh

在Linux环境下,尽管没有直接的Google Talk客户端,但可以借助在线工具或者利用第三方客户端,如Pidgin,它支持Google Talk的通信协议。不过,使用这些工具需要拥有Gmail账号。针对Linux独立的GTalk客户端,例如有支持语音和文件传输的开源项目,作者已分享了源码。以下是编译和安装的步骤:确保你的libjingle库已包含所需的库,如build-essential、libogg-dev、libopenssl-dev等。其中,libgtk2.0-dev虽然未直接使用,但因libjingle依赖的linphone模块需要。

对于希望在Linux上实现语音功能的用户,需要安装libmediastreamer0-dev、libspeexdsp-dev、libtheora-dev等库。在其他系统上,java源码1.8这些库可能不适用。

另外,ilbc源码也在附件中,安装过程简单,但可能在部分系统上语音功能受限。按照readme文件的说明,执行configure、make和make install即可,然后重新配置libjingle。

扩展资料

Google Talk是Google的IM工具,除了具有IM功能外,另外还加上了Viop功能,界面清新大方,可直接链接Gmail,接受查看邮件。详解 WebRTC 协议原理与框架、WebRTC编程问题迎刃而解

WebRTC,全称Web Real-Time Communication,是一种允许网页浏览器进行实时语音和视频对话的API,自年由Google等公司开源并被W3C推荐后,迅速在开发者中普及。它通过SRTP加密RTP数据,确保通信的安全性。核心架构由四部分组成:Voice Engine、Video Engine、Transport以及应用层API,各自处理音频、视频、传输和扩展功能。

在架构图中,绿色部分代表WebRTC核心层,提供基础API,紫色部分是应用层,开发者可以根据需要扩展。核心层的Voice Engine包含编码解码、网络适配和回音消除等功能,Video Engine负责VP8/VP9视频编解码,以及防止视频抖动和图像处理。Transport模块则利用UDP协议实现高效、实时的数据传输,并通过计算估计网络带宽,支持非音视频数据传输。

要使用WebRTC,开发者可以利用javascript Web API或本地C++ API,开发实时通信应用。WebRTC允许基于浏览器的网络流API、RTCPeerConnection和P2P数据API构建应用,如音频视频聊天。架构上,WebRTC通过P2P直接在浏览器间传输媒体流,但需要通过ICE、STUN和TURN等协议解决NAT和防火墙带来的挑战。

WebRTC协议栈涉及RTP、SETP、SCTP等协议,Session组件基于libjingle库,而Transport层则使用了libjingle的网络和传输组件。源码结构复杂且快速变化,涉及PeerConnection、模块化设计、网络传输模块和基础网络协议理解,如RTP报头格式、RTCP报告和扩展等。

学习WebRTC需要对基本网络协议有深入理解,如RTP负载格式、RTP报头扩展以及RTCP报告间隔。资源方面,可通过书籍、示例代码和开发者社区来深入学习,如跨平台的WebRTC Demo项目。

WebRTC入门:iOS工程

刚进入项目组,接手WebRTC相关任务。项目需求基于最新WebRTC版本进行二次开发,但其工程使用gn和ninja编译,每次修改需编译成lib或framework,过程繁琐。本文记录WebRTC OC工程分离过程中的经验与教训。

WebRTC,全称为Web Real-Time Communication,是实现实时语音与视频通话的技术,由谷歌于年通过收购Global IP Solutions公司获得。自年5月开源以来,得到广泛支持与应用,成为下一代视频通话的标准。

要获取WebRTC iOS版本源码,首先需设置git代理。由于不可抗力,需自行配置。

编译WebRTC库时,使用GN生成ninja工程文件。了解GN与ninja基本使用,可以借助官方教程,直接编译出WebRTC.framework。官方提供编译脚本,可方便编译静态库或Framework版本,并支持指定编译条件,如debug版本或是否开启bitcode。

目标是将WebRTC.framework集成至Xcode工程,仅关注OC部分的二次开发,减少对C++代码的关注。分离工程需在现有基础上进行,尽量减少源码修改。

生成libjingle_peerconnection_all库,需在/webrtc/BUILD.gn文件中添加新目标,并在build/ios/build_ios_libs.sh脚本中增加编译选项。此过程需按照官方教程进行。

创建WebRTC_OC工程,在webrtc/sdk/objc目录下,参照rtc_sdk_common_objc和rtc_sdk_framework_objc配置,选择性添加所需Framework文件夹代码文件。

分离工程过程中,需关注现有代码库依赖。完全分离需对头文件引用进行大量修改。分离工程旨在最小化修改,进行优化。

总结接触WebRTC代码的经验,分离OC工程虽有助于专注二次开发,但需谨慎处理现有代码库依赖问题。若需完全分离,需对源码进行大量修改。了解更多细节请参阅原文链接。