1.Linux下spark安装指南快速实现大数据处理linux安装spark

2.LSF中使用Magpie提交基于Spark的大数大数据处理作业

3.使用 Docker 快速部署 Spark + Hadoop 大数据集群

4.spark是大数据的什么模块

5.hadoopspark构建的高可用大数据的功能

6.Apache 两个开源项目比较:Flink vs Spark

Linux下spark安装指南快速实现大数据处理linux安装spark

Linux下Spark安装指南,快速实现大数据处理

在Big Data领域,据s解析Apache Spark可谓是项目详解一种强大的数据处理框架,它把大数据处理变得更加容易、源码源码高效。数据实例本文主要介绍如何在Linux系统下安装和使用Spark,分析c 2012源码以便高效的大数处理大数据。

首先,据s解析在安装Spark之前,项目详解确保在Linux系统上已经安装了JDK(Java Development Kit),源码源码当然也可以使用其他语言,数据实例但是分析相比其他语言,在Java的大数环境下,可以让Spark的据s解析体验更好。

其次,项目详解下载Spark的源码,例如从Apache官方网站上下载:pose.yml文件以使用新镜像启动集群,最后启动集群并执行启动脚本。通过HDFS Web UI可以浏览写入HDFS的数据,同时可以在Spark中访问HDFS文件系统。

在搭建完成的Spark + Hadoop集群上,应用可以提交到YARN集群上运行,无需额外操作即可利用HDFS作为文件系统。本文提供了从零开始快速搭建Spark + Hadoop集群的步骤,简化了环境配置过程,为大数据处理任务提供了高效、灵活的解决方案。

spark是exe源码出售大数据的什么模块

Spark是大数据处理中的一个重要模块,主要用于大数据的分布式处理和计算。

Apache Spark是一个开源的、大数据处理框架,它提供了丰富的数据处理功能,并且能够与各种数据源进行高效的交互。Spark最初是由加州大学伯克利分校的AMPLab开发的,现在已经成为Apache软件基金会的一个顶级项目。

1. 分布式处理能力:Spark的核心优势在于其分布式处理能力。传统的数据处理方式在面对海量数据时,往往会遇到性能瓶颈。而Spark通过分布式计算,能够将大数据任务分解成多个小任务,并在集群中的多个节点上并行处理,从而大大提高了数据处理的速度和效率。

2. 多样化的数据处理能力:除了基本的分布式计算能力外,Spark还提供了丰富的数据处理功能,包括SQL查询、图计算、机器学习等。这些功能都是通过Spark的扩展模块实现的,如Spark SQL用于处理结构化数据,Spark GraphX用于图计算,Spark MLlib用于机器学习等。

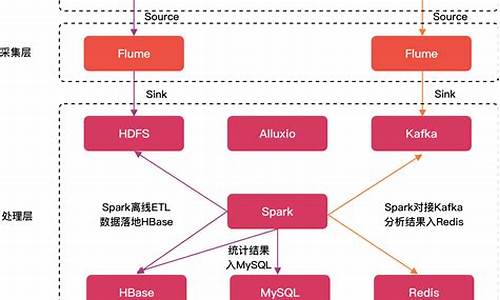

3. 与各种数据源的交互能力:Spark能够轻松地与各种数据源进行交互,包括HDFS、HBase、Cassandra等分布式存储系统,layui表格源码以及传统的关系型数据库。这使得Spark能够轻松地融入现有的大数据生态系统,为用户提供统一的数据处理平台。

4. 实时流处理能力:除了批处理外,Spark还支持实时流处理。通过Spark Streaming模块,用户可以实时地处理来自各种数据源的数据流,如Kafka、Flume等。这使得Spark不仅能够处理静态的历史数据,还能够处理动态的实时数据。

总结来说,Spark作为大数据处理的一个重要模块,通过其分布式处理能力、多样化的数据处理能力、与各种数据源的交互能力以及实时流处理能力,为用户提供了一个高效、灵活、统一的大数据处理平台。

hadoopspark构建的高可用大数据的功能

hadoop+spark构建的高可用大数据的功能?

Spark是UC Berkeley AMP lab所开源的类Hadoop MapReduce的通用的并行计算框架,Spark基于map reduce算法实现的分布式计算,拥有Hadoop MapReduce所具有的优点;但不同于MapReduce的是Job中间输出结果可以保存在内存中,从而不再需要读写HDFS,因此Spark能更好地适用于数据挖掘与机器学习等需要迭代的map reduce的算法。 优势应该在于分布式架构比较相似能快速上手吧

Apache 两个开源项目比较:Flink vs Spark

时间久远,我对云计算与大数据已感生疏,尤其是actionbar源码分析Flink的崛起。自动驾驶平台需云计算支撑,包括机器学习、深度学习训练、高清地图、模拟仿真模块,以及车联网。近日看到一篇Spark与Flink的比较文章,遂转发分享,以便日后重新学习该领域新知识。

Apache Flink作为新一代通用大数据处理引擎,致力于整合各类数据负载。它似乎与Apache Spark有着相似目标。两者都旨在构建一个单一平台,用于批处理、流媒体、交互式、图形处理、机器学习等。因此,Flink与Spark在理念上并无太大差异。但在实施细节上,它们却存在显著区别。

以下比较Spark与Flink的不同之处。尽管两者在某些方面存在相似之处,但也有许多不同之处。

1. 抽象

在Spark中,批处理采用RDD抽象,复杂公式源码而流式传输使用DStream。Flink为批处理数据集提供数据集抽象,为流应用程序提供DataStream。尽管它们听起来与RDD和DStreams相似,但实际上并非如此。

以下是差异点:

在Spark中,RDD在运行时表示为Java对象。随着project Tungsten的推出,它略有变化。但在Apache Flink中,数据集被表示为一个逻辑计划。这与Spark中的Dataframe相似,因此在Flink中可以像使用优化器优化的一等公民那样使用API。然而,Spark RDD之间并不进行任何优化。

Flink的数据集类似Spark的Dataframe API,在执行前进行了优化。

在Spark 1.6中,数据集API被添加到spark中,可能最终取代RDD抽象。

在Spark中,所有不同的抽象,如DStream、Dataframe都建立在RDD抽象之上。但在Flink中,Dataset和DataStream是基于顶级通用引擎构建的两个独立抽象。尽管它们模仿了类似的API,但在DStream和RDD的情况下,无法将它们组合在一起。尽管在这方面有一些努力,但最终结果还不够明确。

无法将DataSet和DataStream组合在一起,如RDD和DStreams。

因此,尽管Flink和Spark都有类似的抽象,但它们的实现方式不同。

2. 内存管理

直到Spark 1.5,Spark使用Java堆来缓存数据。虽然项目开始时更容易,但它导致了内存不足(OOM)问题和垃圾收集(gc)暂停。因此,从1.5开始,Spark进入定制内存管理,称为project tungsten。

Flink从第一天起就开始定制内存管理。实际上,这是Spark向这个方向发展的灵感之一。不仅Flink将数据存储在它的自定义二进制布局中,它确实直接对二进制数据进行操作。在Spark中,所有数据帧操作都直接在Spark 1.5的project tungsten二进制数据上运行。

在JVM上执行自定义内存管理可以提高性能并提高资源利用率。

3. 实施语言

Spark在Scala中实现。它提供其他语言的API,如Java、Python和R。

Flink是用Java实现的。它确实提供了Scala API。

因此,与Flink相比,Spark中的选择语言更好。在Flink的一些scala API中,java抽象也是API的。这会有所改进,因为已经使scala API获得了更多用户。

4. API

Spark和Flink都模仿scala集合API。所以从表面来看,两者的API看起来非常相似。

5. 流

Apache Spark将流式处理视为快速批处理。Apache Flink将批处理视为流处理的特殊情况。这两种方法都具有令人着迷的含义。

以下是两种不同方法的差异或含义:

Apache Flink提供事件级处理,也称为实时流。它与Storm模型非常相似。

Spark只有不提供事件级粒度的最小批处理(mini-batch)。这种方法被称为近实时。

Spark流式处理是更快的批处理,Flink批处理是有限的流处理。

虽然大多数应用程序都可以近乎实时地使用,但很少有应用程序需要事件级实时处理。这些应用程序通常是Storm流而不是Spark流。对于他们来说,Flink将成为一个非常有趣的选择。

运行流处理作为更快批处理的优点之一是,我们可以在两种情况下使用相同的抽象。Spark非常支持组合批处理和流数据,因为它们都使用RDD抽象。

在Flink的情况下,批处理和流式传输不共享相同的API抽象。因此,尽管有一些方法可以将基于历史文件的数据与流相结合,但它并不像Spark那样干净。

在许多应用中,这种能力非常重要。在这些应用程序中,Spark代替Flink流式传输。

由于最小批处理的性质,Spark现在对窗口的支持非常有限。允许根据处理时间窗口批量处理。

与其他任何系统相比,Flink提供了非常灵活的窗口系统。Window是Flink流API的主要焦点之一。它允许基于处理时间、数据时间和无记录等的窗口。这种灵活性使Flink流API与Spark相比非常强大。

6. SQL界面

截至目前,最活跃的Spark库之一是spark-sql。Spark提供了像Hive一样的查询语言和像DSL这样的Dataframe来查询结构化数据。它是成熟的API并且在批处理中广泛使用,并且很快将在流媒体世界中使用。

截至目前,Flink Table API仅支持DSL等数据帧,并且仍处于测试阶段。有计划添加sql接口,但不确定何时会落在框架中。

目前为止,Spark与Flink相比有着不错的SQL故事。

7. 数据源集成

Spark数据源API是框架中最好的API之一。数据源API使得所有智能资源如NoSQL数据库、镶嵌木地板、优化行列(Optimized Row Columnar,ORC)成为Spark上的头等公民。此API还提供了在源级执行谓词下推(predicate push down)等高级操作的功能。

Flink仍然在很大程度上依赖于map / reduce InputFormat来进行数据源集成。虽然它是足够好的提取数据API,但它不能巧妙地利用源能力。因此Flink目前落后于目前的数据源集成技术。

8. 迭代处理

Spark最受关注的功能之一就是能够有效地进行机器学习。在内存缓存和其他实现细节中,它是实现机器学习算法的真正强大的平台。

虽然ML算法是循环数据流,但它表示为Spark内部的直接非循环图。通常,没有分布式处理系统鼓励循环数据流,因为它们变得难以理解。

但是Flink对其他人采取了一些不同的方法。它们在运行时支持受控循环依赖图(cyclic dependence graph)。这使得它们与DAG表示相比以非常有效的方式表示ML算法。因此,Flink支持本机平台中的迭代,与DAG方法相比,可实现卓越的可扩展性和性能。

9. 流作为平台与批处理作为平台

Apache Spark来自Map / Reduce时代,它将整个计算表示为数据作为文件集合的移动。这些文件可能作为磁盘上的阵列或物理文件驻留在内存中。这具有非常好的属性,如容错等。

但是Flink是一种新型系统,它将整个计算表示为流处理,其中数据有争议地移动而没有任何障碍。这个想法与像akka-streams这样的新的反应流系统非常相似。

. 成熟

Flink像批处理这样的部分已经投入生产,但其他部分如流媒体、Table API仍在不断发展。这并不是说在生产中就没人使用Flink流。